選択範囲の物体をスピーディーに再生成する技術

ここのMethodに諸々書いてあるよ

なんとなく解ったことをメモしたよ

Method

<参照元 https://layered-diffusion-brushes.github.io/>

基本知識として……画像生成はlatentノイズ(ランダムな点の集合体)から傾向を見出して画像を生成する

(よくLLMに「挙動的にはノイズを取り除くんだよ」と校正されるけど、latentが厳密にはノイズじゃない以上その言い方だって正確じゃない気がする)

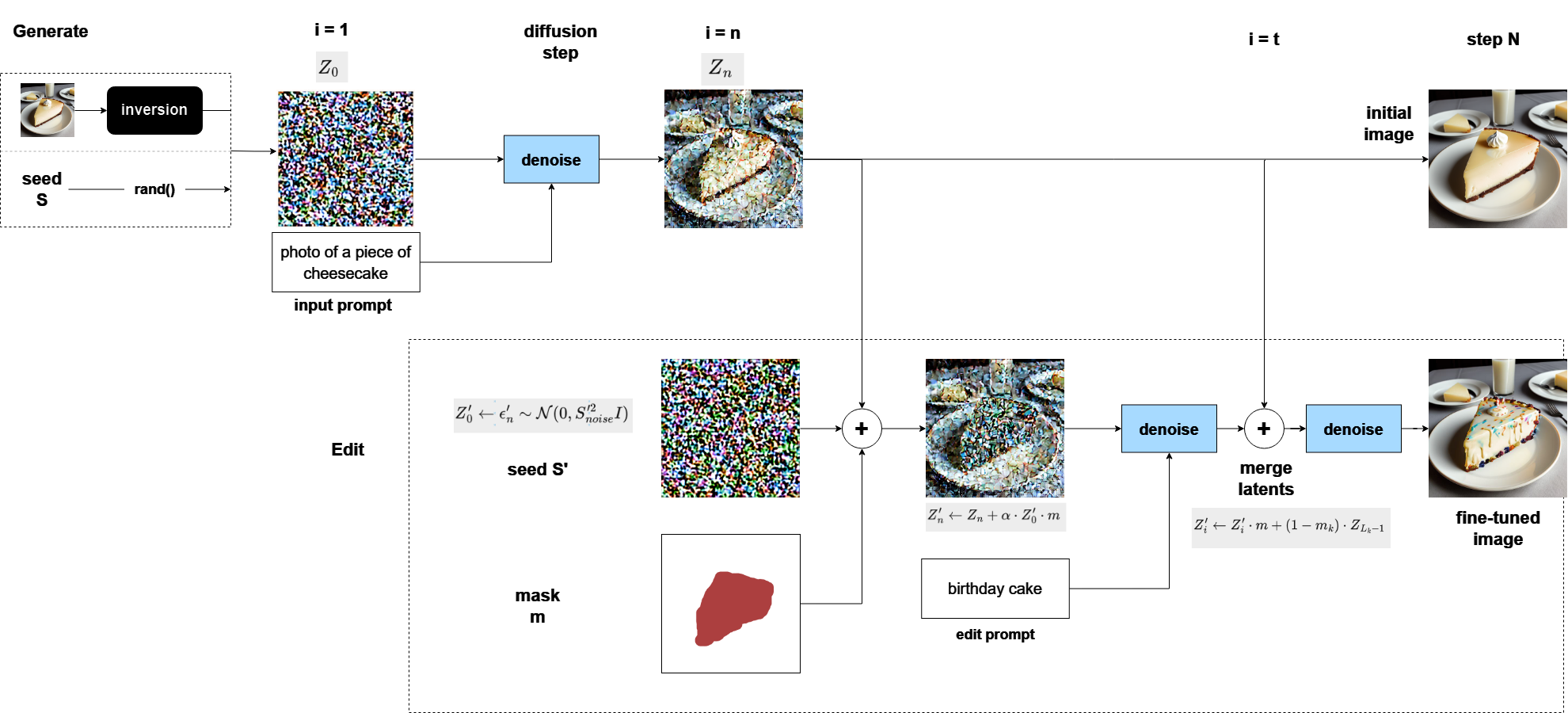

Method上段は通常の生成、これがベース画像となる(画像A)

キモになるのはMethod下段

まず画像Aの生成中*1 の画像を抜き出し、ケーキ型のノイズ(変更したい物体のシルエット)を上乗せする。

この編集済みノイズにbirthday cakeというプロンプトを与えて、画像Bを生成(denoise)

生成した画像Bとベース画像Aをmarge latentする。

marge latentとは要素と要素の合体。たとえば薔薇の画像と少女の画像をmarge latentすると、赤髪で巻き毛など薔薇の要素を持った少女になる。

今回の場合、画像Aの通常ケーキと画像Bのbirthday cakeが混ぜられ、fine-turned Imageが完成した。

この手法では主にケーキ型のノイズにbirthday cakeのプロンプトがかかっているため、マージしてもケーキ以外の部分は影響を受けない。

おそらく画像Bはとても色とりどりなケーキのはず。最後にベース画像Aと画像Bとマージすることで、ベースから離れた印象になりすぎることを防いでいる。

*1 生成途中をわざわざ使っているのは、生成完了後だとケーキ型ノイズ以外の部分が融通が利かなくなるからかな

融通が利かなくなるというのは、絵が固まっちゃうというか、つじつま合わせ(皿の部分とか)がうまくされなくなるというか、なんというか……

例えば、だめなinpaintをみればわかるように、再生成すると該当部分が浮いたり、不自然に途中で切れたりする。

生成途中の、ノイズがまだ残っている状態なら、絵が変化しうる状態だからこの問題がなくなる。

他の理由もあるかもしれない。速度面もありそう。

やっていることは単純だからMethodだけならComfyUIで再現可能だと思う……根幹の発想ってだけだから再現してもあまり意味はないけれど。

シルエット型ノイズの発想は使えそう?

画像生成はベクトルというか概念の指向性?というか、とにかくそのようなものだとわかるとこの手の話もなんとなくわかるようになった

なんというか……画像生成って……絵や概念をこねこねしてる……たぶん

ピクセルに囚われているのはむしろ人間なのかな……しかし画像生成は根幹が違うことがわかると、人間のフローを学ばせるのって遠回りかもしれない

線画→ペン画やスタイル変更の技術と、1から生成する技術は異なるラインで考えないといけないかも?

漫画補助とか……最初から漫画風の生成モデルを使うんじゃなくて「描き足し生成し、後から漫画スタイルを適用する」のほうが自然な気がしてきた。

型に合わせて完成させてから嵌めるより、柔らかいうちに嵌めてから調整したほうが速いもんね

ただ実写とイラストは違うから、ベースとなるイラストスタイルがあって漫画風・油絵風と乗せるほうが現実的かな

それがどんなものかは模索が必要だしそこに時間を割くのは悩ましいところだけど……